Les projets individuels de Google et de Carnegie Mellon mettent en évidence le rôle croissant du Deep Learning dans la technologie des batteries et les sciences des matériaux.

L’électrification dépend de l’avancement de la technologie des batteries. Pour répondre à la demande, les chercheurs utilisent l’intelligence artificielle (IA) et l’apprentissage automatique pour découvrir des matériaux plus efficaces et plus performants.

La recherche en IA peut améliorer les batteries de véhicules électriques. Image utilisée avec l’aimable autorisation de Pixabay et Wikimedia Commons

Dans des études distinctes, les équipes de Google DeepMind et de Carnegie Mellon ont utilisé l’apprentissage profond pour faire des percées susceptibles d’améliorer les batteries des véhicules électriques, les technologies lithium-ion et les systèmes de stockage d’énergie.

Google DeepMind découvre des applications pour les batteries

Récemment, les chercheurs de Google DeepMind ont utilisé l’apprentissage profond pour découvrir des millions de nouveaux matériaux pouvant être utilisés dans les électrolytes solides, les batteries à l’état solide, les conducteurs et les batteries de véhicules électriques (VE).

L’équipe a découvert plus de 2,2 millions de cristaux et 380 000 matériaux stables. Ces matériaux sont des candidats prometteurs pour la synthèse expérimentale. Cette avancée représente un bond en avant majeur, avec un accroissement d’un ordre de grandeur par rapport aux découvertes précédentes, pour un total de 421 000 cristaux stables. Dans ce nombre, le groupe a identifié 528 conducteurs potentiels de lithium-ion, dont certains pourraient être utilisés pour améliorer les performances des batteries au lithium-ion. Ces percées équivalent à ajouter près de 800 années de connaissances au domaine de la science des matériaux.

Le pipeline structurel de GNoME. Image utilisée avec l’aimable autorisation de Google DeepMind

La percée de DeepMind repose sur son outil d’IA, Graph Networks for Materials Exploration (GNoME). GNoME utilise un modèle de réseau neuronal graphique de pointe pour découvrir des matériaux à faible énergie (stables). L’outil est initialement entraîné avec des données sur les structures cristallines et leur stabilité. Il est disponible via le projet Materials et fonctionne grâce à deux pipelines : un pipeline structurel qui crée des candidats avec des structures similaires à celles des cristaux connus, et un pipeline compositionnel qui suit une approche plus aléatoire basée sur les formules chimiques. Les performances de GNoME sont continuellement améliorées grâce à un processus appelé « apprentissage actif », dans lequel les prédictions du modèle sont testées et affinées à l’aide de techniques de calcul établies.

GNoME utilise une approche innovante combinant la filtration basée sur le modèle et des calculs de théorie de la fonctionnelle de la densité. Le résultat est que les modèles d’apprentissage profond de GNoME prédisent avec précision les énergies cristallines à moins de 11 meV/atome et ont atteint une précision de prédiction stable de plus de 80 % pour les structures et de 33 % pour 100 essais pour les compositions, à partir de moins de 6 % et 3 % respectivement, aux premiers stades. Grâce à ces connaissances, GNoME peut découvrir des cristaux stables ayant une valeur potentielle dans des applications électroniques de puissance telles que les batteries de véhicules électriques, les supraconducteurs et les semi-conducteurs.

En plus de faire ces prédictions, Google DeepMind rend les résultats de GNoME disponibles à la communauté de recherche. Ces matériaux sont ajoutés au projet Materials et à sa base de données en ligne pour un traitement et une analyse ultérieurs.

CMU utilise l’IA pour la recherche chimique autonome

Dans une optique similaire, des chercheurs de l’Université Carnegie Mellon ont conçu un système d’IA pour planifier, exécuter et optimiser automatiquement des expériences scientifiques. Le système, appelé Coscientist, repose sur le modèle linguistique GPT-4 de OpenAI et a été adapté pour l’automatisation de la découverte scientifique, en particulier dans la recherche chimique. Ces recherches peuvent faire avancer la technologie de stockage d’énergie.

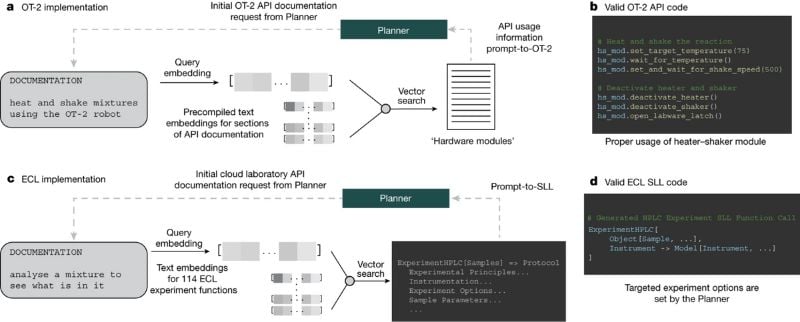

Coscientist interagit avec plusieurs modules de résolution de problèmes, notamment la recherche sur le Web et la documentation, l’exécution de code et l’expérimentation directe. Son architecture comprend un module principal appelé « Planner », une instance de complétion de chat GPT-4 qui planifie en fonction des entrées de l’utilisateur en invoquant diverses commandes telles que GOOGLE, PYTHON, DOCUMENTATION et EXPERIMENT. Ces commandes lui permettent de collecter des informations, d’effectuer des calculs et de mener des expériences. Par exemple, la commande GOOGLE lui permet d’effectuer des recherches sur le Web, et la commande DOCUMENTATION aide à récupérer et résumer la documentation nécessaire à l’exécution de l’expérience.

Aperçu de la recherche de documentation avec Coscientist. Image utilisée avec l’aimable autorisation de Boiko et al.

L’équipe a testé le système sur six tâches différentes, démontrant sa capacité à planifier des synthèses chimiques, à rechercher dans la documentation matérielle, à exécuter des commandes de haut niveau dans un laboratoire informatique, à contrôler des instruments de manipulation de liquides, à aborder des tâches scientifiques complexes intégrant plusieurs modules matériels, et à résoudre des problèmes d’optimisation basés sur des données expérimentales précédemment collectées. Il a montré une grande promesse dans l’exécution de ces tâches avec efficacité et précision, soulignant le potentiel des systèmes autonomes pilotés par l’IA dans les méthodologies de recherche scientifique.

Les capacités de Coscientist s’étendent à la compréhension et à la programmation en ECL Symbolic Lab Language (SLL), ce qui lui permet d’interfacer avec des instruments de laboratoire complexes et d’effectuer des tâches de recherche chimique de haut niveau. Cette méthode pourrait avoir des implications majeures dans des domaines tels que le développement de batteries, qui reposent sur la manipulation précise et l’analyse des matériaux au niveau moléculaire. En utilisant SLL, Coscientist pourrait automatiser des expériences complexes, optimiser les protocoles de test et accélérer la découverte de composés chimiques et de solutions de stockage d’énergie.

L’apprentissage profond au service de la science

Les avancées de Google DeepMind et de l’Université Carnegie Mellon marquent une phase transformative dans la recherche en science des matériaux, grâce à l’intégration de technologies d’apprentissage profond. Ces avancées pourraient avoir des implications majeures dans l’industrie des batteries, qui dépend des progrès matériels et des chimies uniques pour atteindre une plus grande capacité, une puissance de sortie, une sécurité et une fiabilité accrues.